目前的自动驾驶AI主要假设所有人的行为都是一样的,并花费无数的资源来适应不一样的情况。这意味着要谨慎行事,例如,当人工智能试图导航时,会在四向停车点上造成持续等待。这种谨慎降低了十字路口发生事故的可能性,但也可能导致其他危险,因为等待中的汽车后面和周围的驾驶员会对其高度保守的驾驶行为做出反应,极有可能出现人类驾驶员追尾自动驾驶汽车的事故。

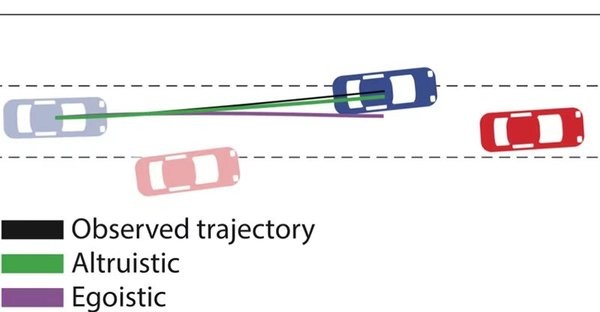

CSAIL团队在论文中概述了如何使用社会心理学和博弈论的方法对人类驾驶员进行分类,从而对人工智能有所帮助。使用所谓的社会价值取向(SVO),司机的评分是基于个人的利己或利他合作的程度。其目的是训练人工智能去给驾驶者分配一个SVO等级,在此基础上创建风险评估,并利用这些信息来改变其自身的行为。

该研究论文的第一作者Wilko Schwarting说:“在自动驾驶汽车中创造更多类似人类的行为,对乘客和周围车辆的安全至关重要,因为以可预测的方式行事能让人类理解并恰当地对自动驾驶的行为做出反应。”

研究人员表示,该系统还可以为人类驾驶员开启第二双眼睛。在盲点探测到具有攻击性的驾驶员时,系统可以在后视镜中发出警报,让驾驶员调整自己的驾驶模式。

据了解,目前该系统还没有用于真正的道路上。但研究人员很快就会开始探索他们的模型如何适用于行人、自行车和其他道路使用者。他们还打算利用社会价值取向来帮助家庭机器人做出决策。